Robots.txt e Sitemap. Contano davvero?

Il file robots.txt e la sitemap sono strumenti che danno ai motori di ricerca informazioni su come indicizzare le pagine di un sito. Sentiamo spesso parlare di questi file, ma di cosa si tratta realmente? E a cosa servono?

Il file robots.txt impedisce ai bot di indicizzare contenuti che è necessario avere sul sito (ad esempio la pagina della privacy policy) ma non si desidera mostrare tra i risultati di ricerca. La sitemap invece esplicita a Google la gerarchia delle pagine del sito, aiutando i crawler a comprendere l’organizzazione dei contenuti.

Vuoi saperne di più? Leggi le nostre indicazioni per sfruttare al meglio le potenzialità di sitemap e robots.txt.

Sitemap

Anche senza sitemap, i crawler di Google riescono a trovare la maggior parte dei contenuti (a patto che questi siano collegati in modo corretto). Tuttavia, aggiungere la mappa del sito aiuta i bot ad eseguire una scansione più efficiente, soprattutto in presenza di una delle seguenti caratteristiche:

- Il sito è molto grande. Nuovi contenuti su siti ricchi di pagine potrebbero essere trascurati dai crawler di Google. In questo caso la sitemap è necessaria, se non fondamentale.

- Il sito è nuovo e riceve pochi link in entrata. Dato che i motori di ricerca scansionano il web passando da un link all’altro, la scarsa quantità di link che puntano al tuo sito rappresenta un motivo ragionevole per creare subito una sitemap e migliorare l’indicizzazione.

- Le pagine del sito non sono collegate in maniera ottimale. È importante dunque assicurarsi che le pagine meno linkate siano elencate all’interno della sitemap, così che possano essere scansionate ed indicizzate dai bot.

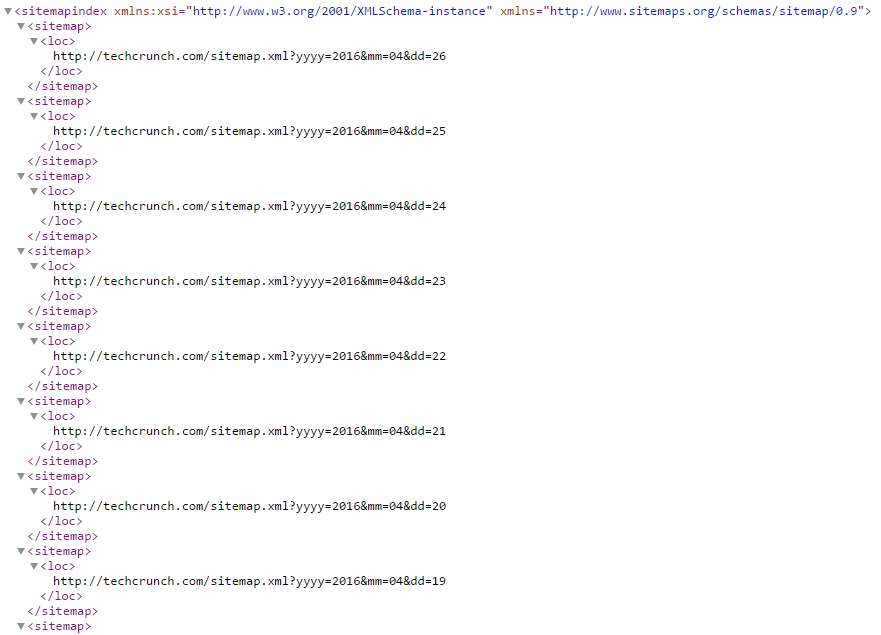

Ecco come appare, ad esempio, parte della sitemap di TechCrunch:

Attraverso la sitemap è possibile dare maggiore risalto a pagine ritenute particolarmente importanti. Puoi infatti fornire utili informazioni da associare alle pagine elencate al suo interno. Grazie all’uso di alcuni meta dati, potrai indicare la frequenza con cui una pagina viene aggiornata, oppure l’importanza di una particolare pagina rispetto ad altre URL del sito.

Se hai già verificato il tuo sito tramite la Search Console di Google, caricare la sitemap richiederà solo pochi minuti del tuo tempo. A questo link troverai tutte le istruzioni necessarie per procedere con il caricamento della sitemap sul tuo sito: https://support.google.com/sites/answer/100283?hl=it

Robots.txt

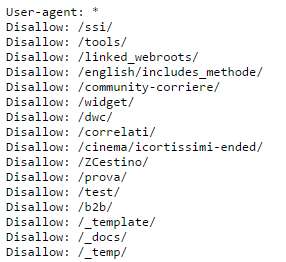

Il file robots.txt è un semplice file di testo che suggerisce ai motori le pagine da non mostrare nei risultati di ricerca perché di scarso valore per chi effettua ricerche su Google (come la pagina della privacy o il log-in al sito).

È importante tenere a mente che chiunque può visualizzare il file robots.txt (basta scrivere “robots.txt” in fondo all’URL del sito). Per questo motivo è meglio evitare di inserirvi nomi di pagine contenenti informazioni che si desidera tenere riservate.

Il file robots.txt standard utilizza tre comandi: “user-agent”, “disallow” e “allow”.

1. User-agent indica i bot dei motori di ricerca. L’elenco che include la maggior parte dei “user-agent” è il Web Robots Database, che puoi consultare qui: http://www.robotstxt.org/db.html.

2. Disallow è un comando indirizzato ai “user-agent”, ai quali viene impedita la scansione di determinate URL (come dicevamo prima, si può utilizzare per le privacy policy, il log-in al sito, ecc.).

3. Allow serve per suggerire ai bot dei motori di ricerca di scansionare delle child directory presenti all’interno di parent directory a cui è stato assegnato il comando “disallow”.

Puoi realizzare il tuo file robots.txt personalizzato utilizzando la seguente sintassi:

User-agent: [nome del bot a cui applicare le regole successive. Il simbolo dell’asterisco permette di selezionare tutti i bot]

Disallow: [URL che vuoi bloccare]

Allow: [URL di cui autorizzi la scansione, nonostante sia presente in una parent directory bloccata]

Ricordati di inserire i comandi “disallow” ed “allow” tante volte quante sono le URL che desideri bloccare. Una volta creato il file, puoi caricarlo tramite l’ftp del tuo sito.

All’interno della Search Console, Google ti dà la possibilità di verificare la correttezza del file che hai caricato. Vai nella sezione “Robots.txt tester” e verifica la presenza di errori.